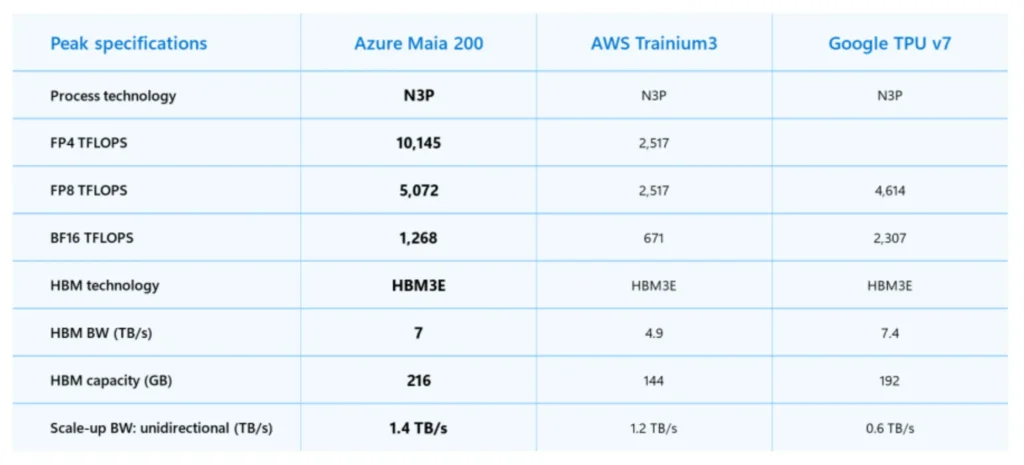

Microsoft, kendi bünyesinde geliştirdiği ilk yapay zeka yongasının halefi olan Maia 200 modelini kamuoyuna duyurdu. TSMC’nin 3 nanometre üretim süreciyle inşa edilen Maia 200 yapay zeka hızlandırıcısı, Microsoft’un beyanına göre “üçüncü nesil Amazon Trainium biriminin üç katı FP4 performansı sergilerken, Google’ın yedinci nesil TPU modelinin ise FP8 performansının ötesine geçiyor.”

Her bir Maia 200 yongası, devasa ölçekli yapay zeka iş yüklerinin üstesinden gelmek üzere kurgulanmış 100 milyardan fazla transistör barındırıyor. Microsoft Bulut ve Yapay Zeka birimi kıdemli başkan yardımcısı Scott Guthrie konuyla ilgili “Maia 200, gelecekteki daha da büyük modeller için geniş bir alan bırakarak günümüzün en hacimli modellerini zahmetsizce çalıştırabilir.” şeklinde bir açıklama yaptı.

Microsoft, Maia 200 birimini OpenAI’ın GPT-5.2 modeli ile Microsoft Foundry ve Microsoft 365 Copilot bünyesindeki diğer sistemleri barındırmak maksadıyla kullanacak. Guthrie ayrıca, “Maia 200, aynı zamanda Microsoft’un şimdiye kadar devreye aldığı en verimli çıkarım (inference) altyapısı olup mevcut filomuzdaki son nesil donanıma kıyasla dolar başına yüzde 30 daha yüksek performans sunmaktadır.” ifadelerini kullandı.

Kurumun başlıca teknoloji rakipleri karşısındaki bu performans iddiası, 2023 yılında Maia 100 ilk piyasaya sürüldüğünde Amazon ve Google’ın yapay zeka bulut kabiliyetleriyle doğrudan kıyaslamalara girilmekten kaçınılan dönemden belirgin bir farklılık gösteriyor. Yine de hem Google hem de Amazon yeni nesil yapay zeka yongaları üzerindeki çalışmalarını sürdürüyor. Hatta Amazon, geliştirilmekte olan Trainium4 yongasını Nvidia’nın MGX raf mimarisi ve NVLink 6 teknolojisiyle entegre etmek amacıyla anılan şirketle iş birliği yürütüyor.

Microsoft bünyesindeki Süper Zeka ekibi, Maia 200 yongalarından faydalanacak ilk grup olacak. Şirket ek olarak akademisyenleri, geliştiricileri, yapay zeka laboratuvarlarını ve açık kaynaklı model projesi paydaşlarını Maia 200 yazılım geliştirme kitinin erken ön izlemesine davet ediyor. Söz konusu yeni yongalar Azure ABD Orta veri merkezi bölgesinde devreye alınmaya başlandı ve diğer bölgelerde de kademeli olarak kullanıma sunulması planlanıyor.

Kaynak: https://www.theverge.com/news/867670/microsoft-maia-200-ai-chip-announcement